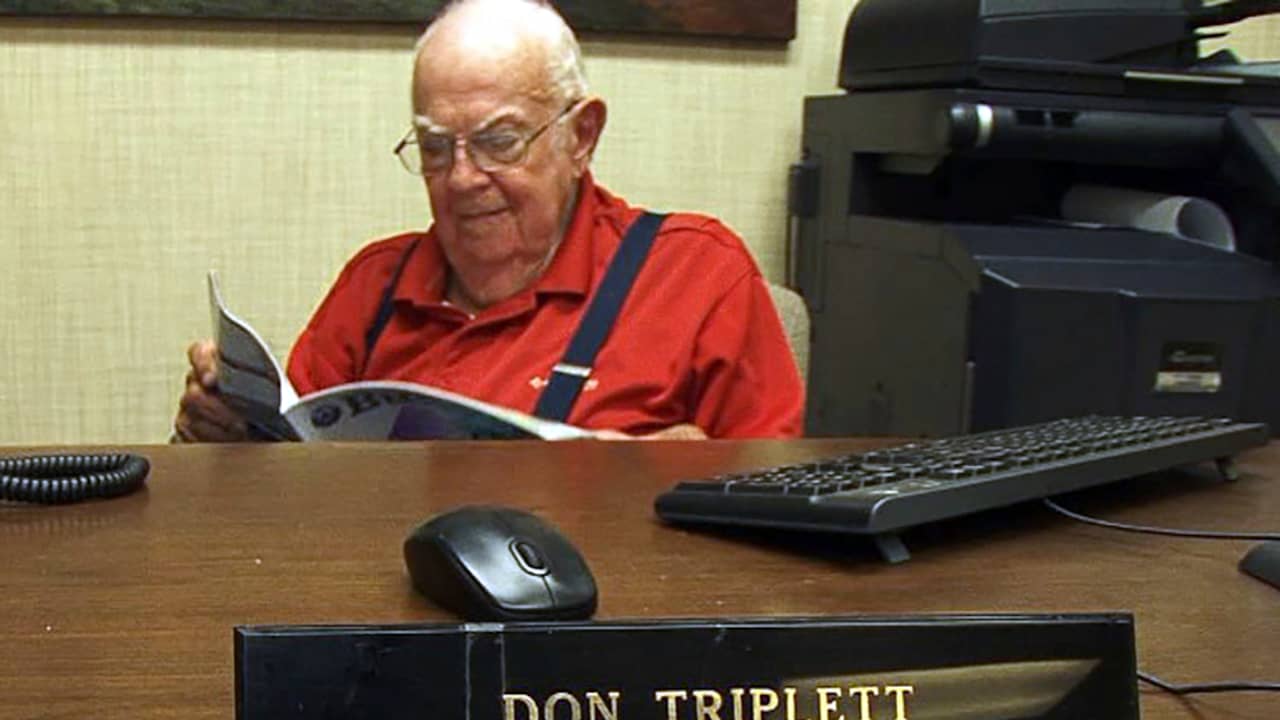

Proprio come le persone a volte cercano se stesse, non ho resistito a “gpt” io e i miei colleghi. ChatGPT, Bing, Bard e altri modelli linguistici non sono macchine dei fatti, ma trovo ancora cose che si distinguono. Un chatbot basato su GPT-3 ha affermato che il collega Jourian, noto per aver recensito giochi e podcast, e io possediamo un cinema e abbiamo vinto premi cinematografici per il nostro lavoro

.

GPT-4 dovrebbe essere migliore e, sebbene ChatGPT non mi abbia assegnato alcun premio con questa versione, mi ha detto che Jurian ha effettivamente lavorato per un’altra azienda per cinque anni come “content strategist”. Sembrava che non avesse mai parlato a nessuno di quella professione, o semplicemente non era vero.

Chiunque lavori con i chatbot lo incontra spesso. I generatori basati su GPT formano continuamente fatti, condizioni o persone. Semplicemente non è un’enciclopedia. È un modello linguistico che tenta di formulare risposte calcolando la parola successiva che ha più senso in base al contesto. Ma perché fa le cose? E si può fare qualcosa al riguardo? È tempo di dare un’occhiata a uno dei grandi svantaggi dei generatori di intelligenza artificiale, ovvero che non puoi fidarti di quello che dicono.

“TV fanatic. Internet addict. Travel evangelist. Aspiring entrepreneur. Amateur explorer. Writer.”